«Надо тестить» – наверняка вы слышали эту фразу из уст программистов, веб-дизайнеров, маркетологов, таргетологов и других рекламщиков. А то и произносили ее сами! Ведь в ней – мудрый прагматизм и в то же время надежда на то, что по итогам практического эксперимента будет найден лучший вариант. Но в этом материале я первым делом хочу разбить всякие надежды на полезность A/B-тестов. А затем вступить в спор с самим собой и выиграть.

Как нам продали идею тестирования

Любой онлайн-сервис сталкивается со скепсисом потенциальных клиентов. И зачастую бронебойных контраргументов у бизнеса нет. Зато способ решения важных для пользователей задач (подчеркну: не ответ, а только способ решения) можно сделать чуть ли не главным УТП. Тот, кто задает острые вопросы, тот и поможет продавать!

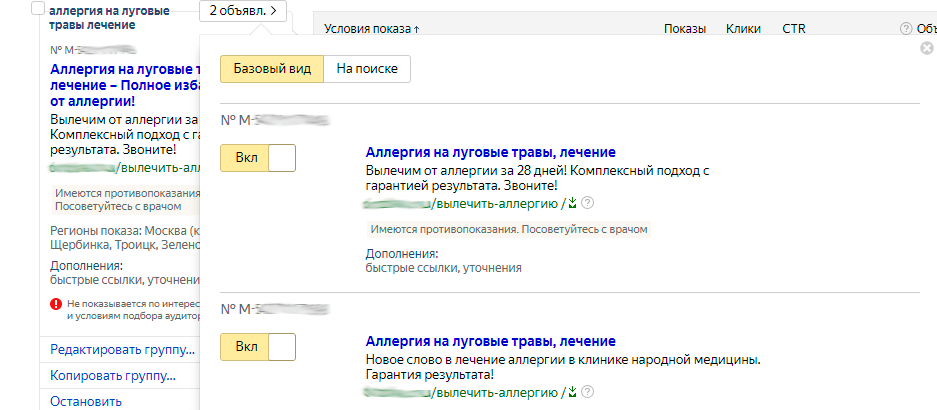

Например, в контекстной рекламе это трюк с несколькими объявлениями внутри одной группы. Заявлено: объявления ротируются по очереди и со временем чаще показывается показавшее наибольший CTR (самое кликабельное). Ну и потом худшие варианты можно отключить, оставив в рекламном поле только одного победителя. Таким образом сервис говорит: на старте мы не гарантируем максимальную эффективность вашей рекламы. Но вы сможете самостоятельно с помощью A/B-тестирования проверять гипотезы и увеличивать кликабельность объявлений.

С email-рассылками – аналогично. Что лучше работает: длинное письмо или короткое? Кнопку с колтуэкшеном ставить в начало письма или в конец? И какого она должна быть цвета: красного, зеленого или синего? На подобные вопросы сервис предлагает отвечать, оперируя накопленной статистикой. Делим подписную базу на равные части, одним отправляем одно письмо, другим – другое… Сравниваем результаты, оставляем вариант с наилучшими показателями и пользуемся им в будущем уже применительно ко всей базе.

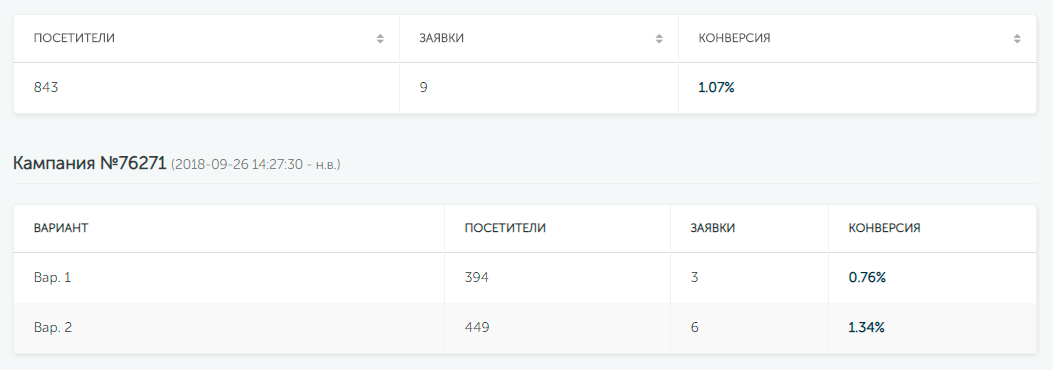

Лендинги и сайты можно улучшать аналогично. Есть готовые плагины и даже функционал в CMS и LP-генераторах, можно написать что-то свое… Суть не меняется: разным сегментам посетителей показываем разное содержимое (слова, цвета, расположение элементов). Вариант с большей конверсией признаем эталоном и рассказываем о нем на вебинарах и конференциях.

Пример статистики по A/B-тесту на лендинге. Конверсия у второго варианта в два раза выше, чем у первого

Можно ли верить в A/B, не доверяя A/A?

В публичном поле об А/А-тестах как-то не сильно много информации. Объясню подробнее для тех, кто совсем с ними не сталкивался. Как и в описанных выше случаях, мы делим аудиторию на равные части. Но показываем им одинаковые объявления и инфоблоки на сайтах, отправляем идентичные письма. Что мы должны получить в идеале? Одинаковый результат, разумеется. Либо почти равенство с погрешностью, не стоящей нашего внимания. Но дотошные юзеры, а также (внимание!) представители самих онлайн-сервисов, проводивших А/А-испытания, на практике часто получают погрешность, которую нельзя игнорировать. И с учетом этой погрешности результаты уже A/B-тестов оказываются вообще сомнительными.

Понятно, что статистический конфуз нужно как-то объяснять. Иначе потенциальный клиент сам прокомментирует полученные погрешности способом, позволяющим отказаться от использования изучаемого сервиса. Мол, если даже А/А-тесту нельзя верить, то и весь инструмент скомпрометирован.

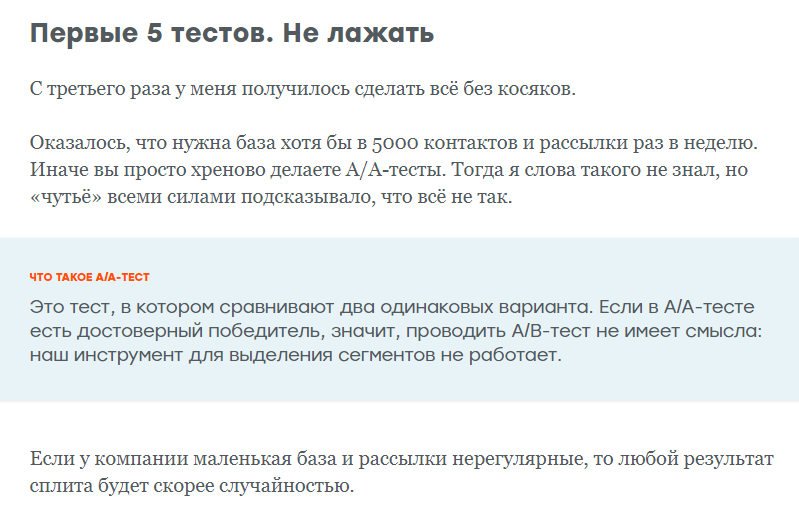

Скрин из блога одного из сервисов email-рассылок

Поэтому в защиту настораживающих фактов приводятся другие. Забавно, что зачастую – противоположные друг другу.

Например, время. Тест длился слишком мало (поэтому небольшой накопленной статистике нельзя верить). Или слишком долго (изменилось множество внешних обстоятельств, поэтому статистика имеет большую погрешность).

Еще вариант – неправильные сегменты. Вы поделили аудиторию поровну в штуках. Но в численно одинаковых половинах оказались неодинаковые по поведению люди. Скажем, в случае email-рассылки в первой половине могло оказаться больше адресатов с корпоративными почтами (то есть представители компаний). А во второй – пользователи бесплатных популярных почтовых сервисов (не всегда, но, как правило, «физики»).

Забегая вперед, в порой странные результаты уже A/B-тестов, необходимо также привести традиционное объяснение традиционных проблем: сравниваемые варианты отличаются больше, чем нужно. Например, в контекстной рекламе вы поменяли и заголовок, и описание, и быстрые ссылки. И теоретически заголовок мог увеличить кликабельность на 15 %. А описание и быстрые ссылки уменьшили ее на 10 % + 5 %. И в итоге, как вы понимаете, результат нулевой. Хотя повышение CTR было у нас почти в руках.

И наоборот: можно, обжегшись на молоке, дуть даже на воду и сравнивать объявления, отличающиеся одним-двумя словами. Для чистоты эксперимента это хорошо, для изучения влияния отличий на людей – не всегда.

Пример хорошего сплита в контекстной рекламе. Объявления в группе различаются не сильно, не слабо, а достаточно. Один посыл – с четкими сроками (28 дней) и сутью лечения (комплексный подход). Второй вариант – про современные методики («новое слово в лечении») с опорой на традиции («в клинике народной медицины»).

Ну и вишенка на торте: когда с помощью теста мы выбираем лучший вариант (A или B) и следующее масштабирование дает нам и вправду хорошие результаты. А вот во второй и/или третий и/или энный раз положительного результата нет. И порой он даже хуже, чем у худшего из двух первоначальных вариантов!

Тесты умерли. Да здравствуют тесты!

Итак, получается, что все сплиты – тлен. Ведь их правдоподобность нивелируют «слишком долго», «слишком коротко», «слишком много вариантов», «слишком мало вариантов», «неправильные сегменты» и вот это вот все. Вернее, не правдоподобность, а возможность практического применения.

И ведь не сказать, что здесь сервисы виноваты. Не они такие, жизнь такая… Вернее, такой уж бизнес в эпоху профицита (превышения предложения над спросом). У нас просто-напросто нет столько времени и столько правильно сегментированной аудитории, чтобы сначала насобирать достаточно статистической информации, а затем, определив лучший вариант, использовать его.

Хохма в том, что по идее этот самый образцовый вариант будет лучше всего работать с той же самой аудиторией, на которой мы тестировали варианты. А с другими аудиториями – не факт! Да и к первой аудитории повторно обратиться мы можем далеко не всегда. А если и можем, то… она ведь уже видела наше первое, неидеальное обращение. А значит, нет эффекта новизны, и это дополнительный сторонний фактор, который мы не учитывали да и не могли учесть при тестировании…

Собственно, запутывать этот клубок можно до бесконечности. И вера в сплиты будет продолжать угасать. Но давайте уже перейдем даже не к вопросу «Что делать?», а сразу к ответу на него!

Нецифровое сегментирование аудитории в digital

Как вы поняли из предыдущих 6 000 знаков, истина кроется где-то в сегментации. Просто потому что мы не в силах основательно повлиять на время, численность аудитории и побочные факторы. А вдобавок в ряде случаев у нас есть всего один шанс на контакт (прямо как в упражнении «презентация в лифте»).

Ключ от всех дверей можно найти только самым ужасным способом: осознав, что не все в digital решается с помощью digital. Вот и А/B-парадокс несложно разбирается с помощью издавна применяемых на практике теорий сегментирования людей по человеческим характеристикам (а не по доменам электропочт или видам устройств, с которых они обычно заходят в интернет).

Оговорюсь, что теорий несколько. И вы можете выбрать ту, которая просто по душе либо больше подходит для вашего бизнеса и/или целевой аудитории.

Иллюстрация поведенческой модели DISC, предложенной около 100 лет назад и работающей по сей день

Интересно, что в большинстве случаев идет деление землян на 4 части. А для упрощения понимания и применения каждый из этих сегментов часто наделяется определенным цветом или словом. Я же предлагаю еще больше упростить, используя оба подхода. Давайте поделим человечество на красных лидеров, зеленых аналитиков, синих болтунов и желтых помощников. А теперь показательно препарируем сплит из двух объявлений в контекстной рекламе.

Условия те же: времени на тест почти нет, аудитория маленькая. Но все-таки крупными мазками мы можем нарисовать собирательный портрет своей ЦА. И в лучшем случае это будут представители одного из четырех сегментов, реже – сразу двух, но не более (иначе вы плохо понимаете свою ЦА).

Соответственно, теперь мы знаем, из чего выбирать тестируемые элементы.

Например, для «красных», благодаря сплиту, можно определить, какой призыв (в рекламе, письме, на лендинге и т. д.) лучше – про первенство, вызов или обогащение. Все три варианта сработают, но тест позволит определить самый эффективный. И впоследствии этот вариант с куда большей вероятностью покажет хорошие результаты на новой, но тоже «красной» аудитории. И будет куда менее подвержен стороннему влиянию именно в силу своего доминирования для мышления данной ЦА. А еще он будет почти универсальным, ведь «красные» есть среди взрослых и подростков, женщин и мужчин, предпринимателей и наемных работников, завсегдатаев Facebook и «Одноклассников»...

Аналогично – с другими цветами.

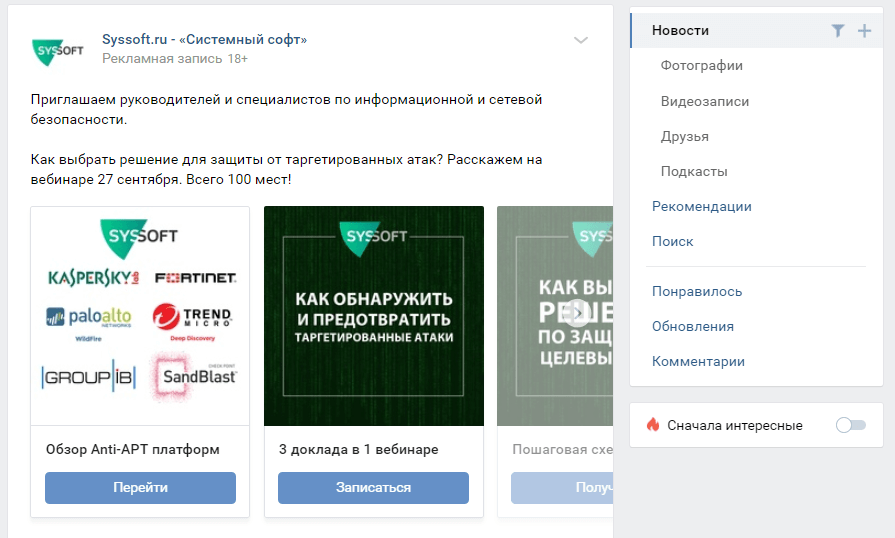

Пример таргетированной рекламы для «зелено-синей» аудитории айтишников. С одной стороны, присутствуют профессиональная семантика, визуальные элементы и цифры, четко обрисован круг участников. С другой – нет «желтых» и «красных» посылов про помощь и сотрудничество, победу и деньги.

Пример таргетированной рекламы для «зелено-синей» аудитории айтишников. С одной стороны, присутствуют профессиональная семантика, визуальные элементы и цифры, четко обрисован круг участников. С другой – нет «желтых» и «красных» посылов про помощь и сотрудничество, победу и деньги.

То есть мы не отказываемся от тестирования как такового. Мы вводим в эксперимент дополнительный этап, ставя его в самое начало. Эдакий приквел, позволяющий проводить сплиты не вслепую, надеясь на некие умные алгоритмы, а уже имея основательный фундамент еще до начала эксперимента.

Теперь понятно, обо что спотыкается логика А/А-тестов. Просто в одинаковых по численности аудиториях нередко разное количество представителей целевого для нас сегмента. Например, где-то больше «зеленых», а где-то – «желтых». Вот и реакция на предложение, выраженное с помощью цифр, фактов и графиков, у первых будет лучше, чем у вторых.

И уж конечно, результаты А/B-тестов могут оказаться какими угодно (читай: бесполезными), если мы хаотично и бездумно обращаемся к людям разных «цветов» на разных «языках». Но когда осознанно используем ту или иную семантику, любой сплит становится действительно эффективным инструментом, позволяющим наращивать не какие-то синтетические, а самые что ни на есть бизнес-показатели.

Знания, которые вы получите на курсе «Интернет-маркетинг СТАРТ», позволят вам легко и самостоятельно разработать комплексную стратегию развития веб-ресурса. Научитесь создавать удобную структуру сайта, находить в социальных сетях потенциальных клиентов. Сможете запустить рекламную кампанию и оценить ее продуктивность.

Авторизуйтесь, чтобы оставлять комментарии