генеральный директор Digital.Tools

Предпосылки усиления роли поведенческих факторов

Процесс, когда поисковая система определяет, какой сайт по вашему запросу вывести на первое место, а какой – на десятое, называется ранжированием. Вывести точную формулу ранжирования невозможно. Многие оптимизаторы указывают, что Google учитывает около 200 достоверных и косвенных факторов ранжирования. Число в 200 факторов берет свою историю с публикации в блоге Backlinko в 2013 году.

Согласно документам на 2009 год, формула Яндекса состоит из более чем 800 факторов для определения позиции страницы в выдаче. На конференции в 2013 представители Яндекса заявляли, что число учитываемых факторов перешло за 1000.

Почему так случилось?

«На заре интернета», когда в сети существовало всего несколько тысяч сайтов, ранжировать страницы было легко. Конкуренция была невысокой. С ростом числа проиндексированных сайтов и страниц поисковые системы стали учитывать количество ссылок, указывающих на ту или иную страницу, измеряя таким образом «авторитетность» ресурса среди других. Изменилась формула просчета того, насколько страница соответствует запросу (релевантности) — ранжироваться стали выше те страницы, которые содержали большее количество ключевых слов.

Это запустило порочный круг черного SEO — часто сайты низкого качества и с отсутствующей пользой для человека быстро выходили в ТОП. В то же время наивные вебмастера и владельцы полезных ресурсов, которые верили в сказки поисковиков: «Просто создавайте контент, которого ждет публика», проигрывали опытным оптимизаторам. В такой ситуации поиск больше не выполнял свою прямую функцию — давать качественный ответ на запрос пользователя.

Последовала волна фильтров и санкций поисковых систем за переоптимизацию кода страниц и контента, за закупку и продажу ссылок, однако эти технические фильтры оптимизаторы научились обходить.

В своё время для поиска лучший

ответ бы самый подробный отчет с точки зрения не только объема и энциклопедичности. Чем больше информации по запросу – тем лучше. Но потом оказалось, что пользователь, который ввел в Яндекс «заказать пиццу», не хочет читать статьи про пиццу. Он хочет, чтобы ему привезли вкусную пиццу быстро и не украли деньги с карты при платеже. Для коммерческих запросов появились новые факторы – коммерческие факторы.

На сегодня алгоритмы ранжирования изменились таким образом, что больше нет каких-нибудь топ 20 факторов, которых достаточно по-быстрому подкрутить и выйти в топ. Факторов много, каждый вносит свой небольшой вклад в общий результат, и в то же время роль каждого из них «размазана» среди множества других факторов.

Низкая эффективность предпринимаемых мер вынудила поисковые системы в корне пересмотреть формулу ранжирования и придать больший вес факторам, которыми не смогут легко манипулировать оптимизаторы и разработчики. И такой фактор легко обнаружился — пользователи.

Поисковые системы стали оценивать поведение пользователей на сайтах и в поисковой выдаче, чтобы определить, заслуживает ли сайт высокую позицию или нет.

Какие поведенческие факторы учитываются при ранжировании?

Поисковые системы разработали специальные алгоритмы обработки поведенческих сигналов на сайтах, чтобы определять степень удовлетворенности пользователя и учитывать данный показатель в общей формуле ранжирования. В Яндексе работает Матрикснет, Google запустил RankBrain (искусственный интеллект, предназначенный понимать, что имел в виду пользователь в запросе, и выдавать наиболее релевантные результаты). Кроме роботов, в поисковиках работают специалисты, которые проверяют вручную, насколько адекватно сработали машинные алгоритмы. Такие специалисты называются асессоры. Google постоянно публикует в свободный доступ инструкции асессорам по оценке качества страницы и ее содержания. Ознакомиться с инструкцией от марта 2016 можно здесь.

На сегодняшний день наблюдения экспертов подтверждают, что на позиции сайта в выдаче влияют:

Возвратная аудитория не из поиска

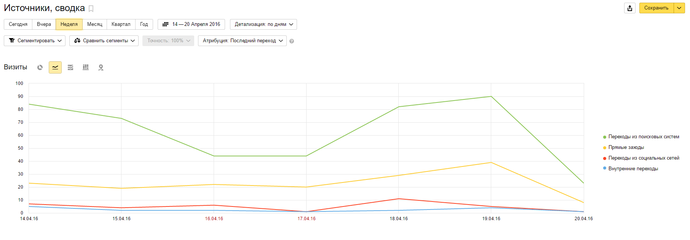

Этот фактор впервые упомянут в материалах по МатриксНет 2009 года. С течением времени его влияние стало сильнее. Грубо говоря, чтобы поисковик дал вам поисковый трафик, нужно, чтобы он увидел у вас непоисковый трафик. В идеале – ядро аудитории, которая постоянно возвращается к вам из разных источников: прямые заходы, реферальный трафик, реклама, контекст, трафик из социальных сетей. Вашим сайтом должны интересоваться ваши сотрудники, партнеры, клиенты, которые будут заходить, набирая название бренда и адрес домена. У вас должен быть платный трафик из различных источников. Ваш контент должен быть весьма полезным, чтобы привлекать аудиторию и т. д. и т. п.

Можно сформулировать так: если поисковая оптимизация является частью вашего комплексного маркетинга в интернете, дела Ваши будут идти лучше чем в случае, когда Ваша планы развития построены только на идее получить трафик из поисковика.

Кликабельность сниппета

Множество экспериментов показывают, насколько важен сниппет. Чем больше людей перейдет к вам на сайт из поисковой выдачи, тем больше вероятность того, что сайт в следующий раз окажется на более высоких позициях. И наоборот – если пользователи кликают на CTR мало, то ваш сайт начнет постепенно сползать вниз. По такому принципу работает многорукий бандит Яндекса: сайту предоставляется шанс, и если CTR высокий, то у него есть шанс остаться в выдаче и дальше. Если низкий – то сайт вернется на свои старые позиции.

При этом Яндекс учитывает, что бывают случаи, когда сайт с низким CTR все равно является хорошим ответом. Как пример – информационный запрос, когда ответ собственно помещается в сниппете. Александр Сафронов, руководитель службы релевантности и лингвистики Яндекса, 4 августа на конференции «Как устроен поиск Яндекса» как раз приводил такие примеры. В этом случае даже почти нулевой CTR не приведет к падению позиций. А «такие случаи» поисковик определяет именно по «поведению» пользователей.

Тема влияния на сниппет достойна отдельной статьи. Но хочу обратить внимание на важность мониторинга сниппетов. Очень часто встречается ситуация, когда оптимизатор вообще не следит за сниппетами и даже не знает, что в сниппет попадает какой-то «технический мусор», снижающий число переходов на сайт из выдачи.

Время на сайте

Время на сайте — время, проведенное пользователем на сайте за одну сессию.

Это один из самых спорных факторов. Хотя алгоритмы поисковых систем реагируют на уменьшение времени, проведенного пользователем на сайте, снижением позиций в выдаче, низкий показатель не говорит о неудовлетворенности пользователя — к примеру, Википедия. Хотя страницы сайта зачастую предоставляют развернутую информацию по запросу, тем не менее ответ часто содержится уже в первом предложении. Пользователь получил ответ и ушел.

Глубина просмотра

Глубина просмотра — это фактическое количество страниц, которые просмотрел пользователь за одну сессию. Тимофей Шиколенков, спикер Пятой Вебмастерской Яндекс (https://events.yandex.ru/events/yamasterskaya/20-may-2016/), поставил под сомнение вес глубины просмотра как фактора ранжирования для коммерческих сайтов.

По мнению спикера, если глубина просмотра в ИМ снижается, это указывает на то, что пользователи быстрее находят интересующие товары и услуги, а так навигация и структура сайта правильные и удобные для пользователя.

С глубиной просмотра и временем сессии, скорее всего, ситуация такая: сайты схожего типа и качества дают глубину просмотра примерно одного порядка. У качественных интернет-магазинов будут схожие характеристики, у сайта-витрины глубина будет значительно ниже, а у классифайдов будет наоборот значительно больше. Поэтому фактически рост в пределах одного порядка, например глубины просмотра с 1.2 страницы до 1.6 страниц, останется незамеченным поисковиком.

Уровень отказов

Уровень отказов — сигнал ранжирования на основе статистики. Высокий уровень отказов указывает на проблемы с сайтом: сложная структура, непонятная навигация, нечитабельный текст, сайт не вызывает доверия. Отказом поисковая система Google (support.google.com/analytics/answer/1009409) считает сессию с просмотром всего одной страницы.

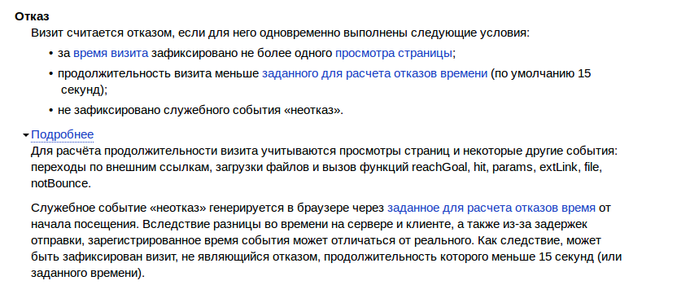

Что такое отказ в понимании Яндекса:

Пользователь отказывается просматривать страницу в случаях, если:

- страница не вызывает доверия — массивные анимированные баннеры, всплывающие окна, запрашивающие контактные данные, большая часть полезной площади экрана занята рекламой, некачественный дизайн, ошибки верстки и прочие факторы;

- страница предоставляет бесполезную информацию;

- текст плохо отформатирован и нечитабелен;

- страница нерелевантна запросу пользователя;

- поисковик не угадал намерение, умысел (интент) пользователя. Пример, на запрос пользователя «Митсубиси» поисковик ему показал страницы про автомобили, а пользователь искал кондиционер.

Это далеко не полный список причин отказов.

Единичный отказ от просмотра страницы не повлияет на ранжирование, а вот массовые возвраты пользователей в выдачу спровоцируют проседание позиций.

Социальные сигналы пользователей

Следующий поведенческий фактор — это социальные сигналы пользователей, а именно, количество лайков и репостов страницы в социальные сети. Этот фактор имеет большее значение для Google. Особенно если страница получает репост в Google+. Пользователи охотно делятся тем, что считают интересным, полезным и ценным. Именно поэтому поисковые системы стали учитывать количество социальных сигналов, исходящих со страницы в ее ранжировании.

На скриншоте один из продвигаемых нами сайтов. Размещение поста в соцсети привело к росту и поискового трафика. Это достаточно типичная картина – хороший сигнал из социальных сетей даёт быстрый прирост поискового трафика, пусть и ненадолго. При этом мы уверены, что накопление данных о социальных сигналах даёт долгосрочный накопительный эффект.

Не все пользователи имеют одинаковую ценность для поисковиков. Если вы, прочитав эту статью, побежите покупать дешёвые репосты в социальных сетях, то скорее всего не увидите никакого результата. Когда-то многие оптимизаторы разуверились в социальных сигналах именно потому, что хотели найти дешёвые и простые в управлении рычаги воздействия на поисковики.

Но ещё раз повторимся: социальные сигналы с дешёвых бирж не дают эффекта.

Неудовлетворённый спрос

Если пользователь пришёл на сайт, не нашёл того, что искал, и вернулся, чтобы продолжить поиск, то поисковик сразу это отметит. Этот фактор очень важен для поисковика, так как поисковику легче с ним работать: все необходимые данные под рукой. В отличие от предыдущих, где требовались данные из систем статистики (которые стоят не на 100% сайтов) или социальных сетей, тут вся информация под рукой.

О накрутках поведенческих факторов

Казалось бы, поведенческие факторы гораздо легче накручивать, чем покупать ссылки и даже создавать переоптимизированный контент. Пишется программа, которая совершает действия на сайте, имитируя паттерн (шаблон) поведения, определенный по записям посещений реальных пользователей (просмотр возможен в Вебвизоре Яндекса metrika.yandex.ru/promo/webvisor).

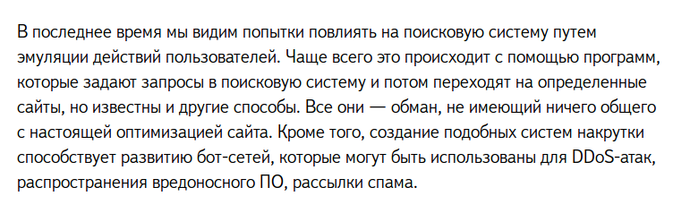

Впервые Яндекс говорит о негативном отношении к накруткам поведенческих факторов в далеком 2011 году (блог Платона Щукина yandex.ru/blog/platon/1872):

Последствия накрутки поведенческих факторов

Наказанием за накрутку ПФ на сайтах стало проседание страниц до той степени, когда их невозможно найти в поиске (люди так глубоко не просматривают выдачу).

Происходит это приблизительно так:

- сайт получает переходы ботов из поисковых систем по определенным запросам;

- алгоритм поисковой системы регистрирует увеличение активности пользователей, вебмастер наблюдает рост позиций;

- происходит апдейт алгоритма, и позиции резко падают.

Служба поддержки Яндекса всегда подтверждает наложение санкций. Типичный ответ от поддержки Яндекса выглядит вот так:

«Здравствуйте!

Скорее всего, причиной изменения позиций Вашего сайта стало использование некорректных методов поискового продвижения ( http://company.yandex.ru/rules/optimization ), например: - эмуляция действий пользователей поисковой системы ( http://webmaster.ya.ru/replies.xml?item_no=10399 ); - массовое использование SEO-ссылок ( http://webmaster.ya.ru/replies.xml?item_no=325 ).

Вероятно, для продвижения Вашего сайта были использованы сервисы или программы, реализующие подобные методы. Такие как Userator, Movebo, WebEffector, SerpClick и тп. Возможно, это было сделано компанией, оказывающей услуги поискового продвижения для Вашего сайта.

Отказ от использования некорректных методов продвижения и оптимизация сайта в интересах пользователя позволят восстановить доверие поисковой системы и занять достойные позиции в выдаче.

-- С уважением, Платон Щукин»

Фактически эффект от накрутки ПФ продлится лишь до первого обновления системы, а вот восстановление позиций займет куда больше времени.

Почему так происходит? Поисковые системы умеют составлять портрет целевого пользователя страницы по срезу данных (местоположение, типично посещаемые сайты, типичное поведение на страницах). При накрутке эти данные не учитываются, и сайт получает всплеск неестественного трафика. Это плохо. Мы настоятельно не рекомендуем пользоваться системами накрутки поведенческих факторов в Яндексе: это приведёт к наложению санкций на ваш сайт на долгий срок. Спросите у подрядчика, не использует ли он Userator, Movebo, WebEffector, SerpClick

Как улучшить ранжирование сайта?

Поисковые алгоритмы постоянно эволюционируют и видоизменяются. Михаил Сливинский, руководитель службы по работе с вебмастерами Яндекса, объясняет это динамичностью интернет-среды. Огромное количество факторов ранжирования усложняет выбор тактики продвижения любого сайта, будь то блог, информационный ресурс или коммерческий сайт (а в этом случае важно учитывать и коммерческие факторы ранжирования для продвижения в Яндекс).

Поисковые системы учитывают юзабилити и адаптивность сайта к мобильным экранам .

2015 год окончательно убедил оптимизаторов в том, что массовая закупка низкокачественных ссылок приводит к проседаниям позиций (Минусинск).

Андрей Гусаров, учредитель GUSAROV group:

«Поразительно как меняется позиция seo-специалистов и интернет-маркетологов. Если только недавно были важны только цифры показов или среднее время проведенное на сайте, сейчас специалисту важно совершение конечного действия.

Поисковые системы пытаются сделать максимум чтоб продавить полноценную работу с сайтом. Напомню, что даже модное нынче тегирование - попытка работы с тем, что действительно нужно потенциальному клиенту. Из последних примеров интересных запросов «диван для холостяка» или «диван для владельца кошки».

Недалеко время когда все поголовно начнут как часть поведенческих считать и retention rate, но это уже другая история.

Уверен, что в будущем поведенческие факторы будут расти по значимости и вариантивность контента не будет вызывать таких странных эмоций как сейчас!»

Другие факторы, влияющие на ранжирование

Сегодня для высокого ранжирования любого интернет-проекта важны:

Трафик — живой, настоящий, релевантный — это пользователи, которые действительно заинтересованы в товаре, услуге, информации, которую вы предоставляете. Отправка на сайт нерелевантного трафика равносильна накрутке ПФ.

Существует много проверенных методов привлечения релевантного трафика на сайт, вот некоторые из них:

- рекламные сети Яндекс и Google;

- работа с пользователями в социальных сетях — социальные сети позволяют вам сегментировать аудиторию по возрасту, стране и городу проживания, интересам и прочим параметрам. Так вы получаете в группу компании целевую аудиторию. Чтобы перенаправить ее на сайт, необходимо, чтобы ценность предложения на сайте превышала «затраты» на действие (переход).

- поиск целевой аудитории на форумах и постинг сообщений с ссылкой на сайт в тематических ветках (при этом важно соблюсти правильное количество постов, чтобы поисковые алгоритмы не расценили действия как спам);

- гостевые посты на сайтах смежной тематики — это не только сайты, целевая аудитория которых может быть потенциально заинтересована в вашем предложении, но и релевантные вашей тематике. К примеру, около 40% молодых мам водят автомобиль, им может быть интересен пост о том, как сэкономить на зимних шинах, а размещение такого поста на известном портале Babyblog сгенерирует поток трафика на продвигаемый сайт, но поисковая система может расценить такой ход как нерелевантный тематике. Санкции за единичные случаи, естественно, не применяются. Но если такие ошибки допускаются часто, то сайт может просесть в позициях.

Контент — правильно оптимизированный для пользователя и для поисковой системы. Важно на страницах учитывать как интересы человека, так и работу поисковых роботов. Даже если страница уникальна, полезна и ценна для пользователя, поисковый робот может неправильно определить ее тематику и показывать пользователям по абсолютно нерелевантным запросам.

Это приведет к высокому уровню отказов, снижению конверсии, ухудшению позиций в поиске. Поэтому сегодня сайту жизненно необходим правильный seo-контент: с правильной плотностью ключевых слов, их расположением, синонимами в тексте, запросами пользователей. С другой стороны — контент должен оставаться полезным и интересным для человека — это сразу улучшит ПФ сайта (время на сайте, глубина просмотров, социальные сигналы).

Стратегия продвижения — создание правильного семантического ядра, распределение его по посадочным страницам, план создания новых посадочных страниц и улучшение контента на них для повышения релевантности.

Коммерческие факторы — параметры, повышающие вероятность посетителем покупки в интернет-магазине. Это очень важная группа для интернет-магазинов и коммерческих сайтов, и о ней мы поговорим в отдельной статье.

Внутренняя оптимизация сайта и сервера, ссылочный профиль важны как и раньше, но оказывают существенное влияние только совместно с другими факторами.

Что из этого следует?

SEO уже не существует чисто в виде, когда базовая внутренняя оптимизация, создание переоптимизированного контента и закупка ссылок выводили сайт на уверенные позиции в ТОП. Сегодня поисковая оптимизация — это синергия множества инструментов, таких как технической оптимизации сайта, внутренней оптимизации, разработки стратегии поисковой оптимизации, правильного распределения семантического ядра по посадочным страницам, качественного улучшения сайта для пользователя, правильного контента и его распространения по наиболее эффективным каналам. Все это долгие и сложные процессы, поэтому не стоит рассчитывать на быстрый результат и низкую себестоимость. Поисковая оптимизация должна стать частью вашего долгосрочного плана интернет-маркетинга.

Авторизуйтесь, чтобы оставлять комментарии